¿Te acuerdas de lo que hiciste el 30 de noviembre de 2022? Probablemente fue un día ordinario y nada especial ocurrió para que lo recuerdes tanto tiempo después. Pero Google sí tiene algo que recordar: ese día, de repente y sin previo aviso, OpenAI presentó una nueva herramienta llamada ChatGPT.

Hay ocasiones en las que ciertas decisiones empresariales pueden provocar cambios significativos en la industria tecnológica, llegando incluso a alarmar a la competencia. Pero esto no siempre ocurre, como sucedió con Nokia y BlackBerry, quienes reaccionaron tarde ante el lanzamiento del iPhone en 2007.

El estreno del chatbot de la empresa liderada por Sam Altman ha causado un gran revuelo en Google. La compañía, que actualmente domina el mercado de las búsquedas, se enfrenta por primera vez en años a una amenaza real que la ha obligado a tomar medidas radicales.

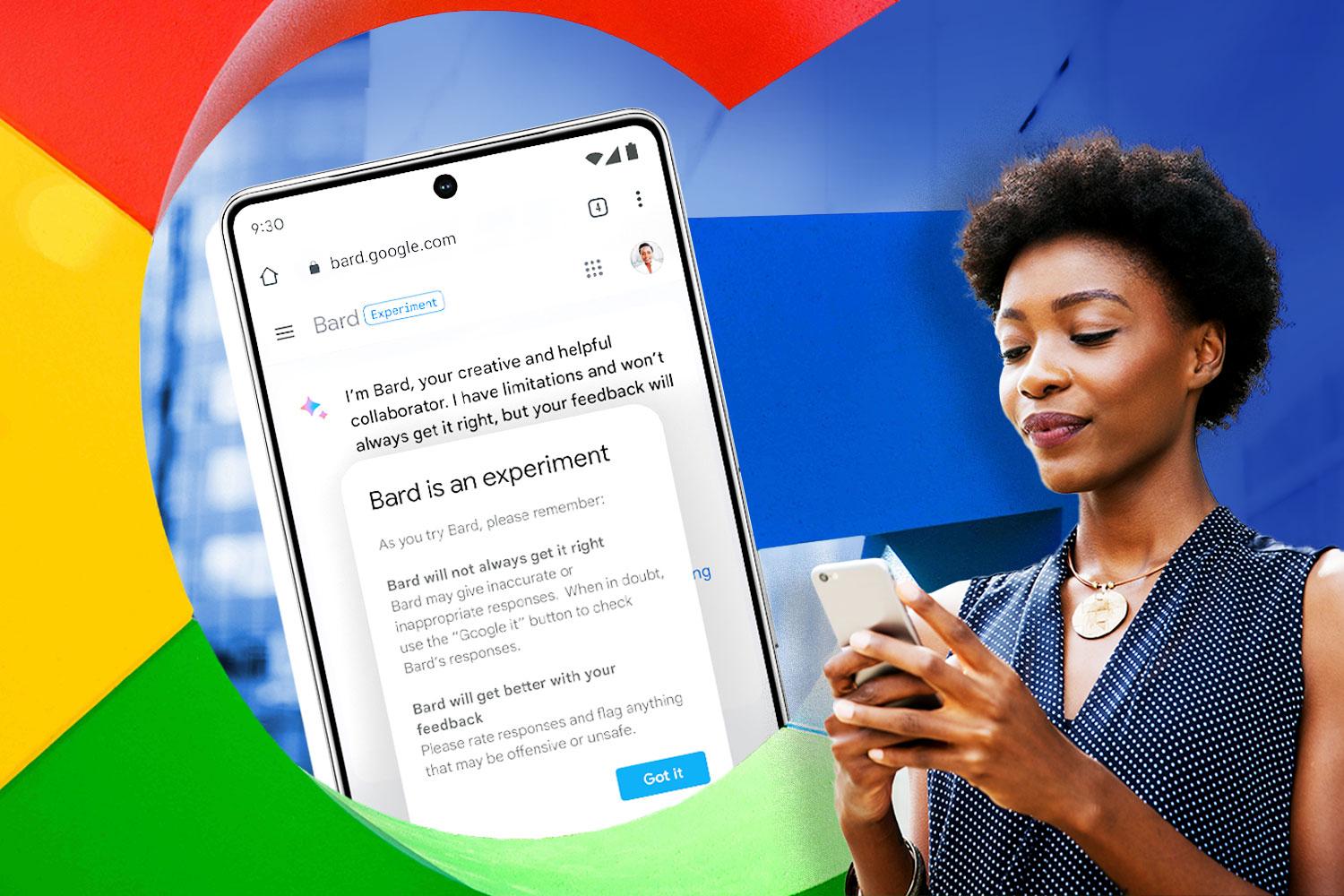

Entre las medidas adoptadas por Google para enfrentar esta amenaza, se encuentra el lanzamiento temprano (actualmente solo disponible en algunos países con invitación) de Bard, que compite directamente con ChatGPT, y su versión mejorada conectada a Internet a través de Bing Chat. Sin embargo, muchos empleados de Google opinan que se trata de un lanzamiento apresurado.

De acuerdo con informes internos vistos por Bloomberg, los subordinados de Sundar Pichai fueron encargados de probar el chatbot de inteligencia artificial impulsado por LaMDA (Language Model for Dialogue Applications) antes de su lanzamiento. A pesar de que muchos de los comentarios eran negativos, la compañía siguió adelante con su plan.

Los comentarios negativos entre los equipos de Google no han pasado inadvertidos. Un empleado evaluó la herramienta Bard en febrero de este año y escribió: «Bard es completamente inútil, por favor, no lo lancen». Otro empleado señaló que el chatbot tenía una tendencia a proporcionar información imprecisa y ofrecer respuestas poco precisas, calificándolo como «un mentiroso patológico».

Después del lanzamiento de ChatGPT, aumentó la tensión y el descontento entre algunos empleados de la compañía debido a una serie de decisiones tomadas por la dirección, según informa el medio estadounidense. Durante varios años, Google se había centrado en fortalecer su equipo de ética para sus proyectos de inteligencia artificial.

La tarea de este grupo de expertos era ayudar en el desarrollo de productos y servicios que cumplieran con los valores y los altos estándares de seguridad de la compañía. Para lograr estos objetivos, se necesitaban muchos recursos que Google se comprometió a proporcionar en 2021, pero también se requería tiempo. Este último resultó ser un obstáculo tras el lanzamiento de OpenAI.

Aunque Google tiene experiencia en el campo de la inteligencia artificial, muchos de sus proyectos más ambiciosos estaban confinados al laboratorio. En 2022, el ritmo de desarrollo se aceleró drásticamente, lo que hizo que ciertas cuestiones éticas importantes quedaran en un segundo plano.

En Google, antes de lanzar un producto al mercado, se exige que cumpla con altos estándares en ciertas categorías. Pero en el caso de Bard, esto cambió. Por ejemplo, la categoría de «seguridad infantil» aún no ha alcanzado una puntuación de 100, mientras que «equidad» se considera aceptable para el lanzamiento si tiene una puntuación de 80 o 85.

Lo que se ha mencionado hasta ahora es información interna que fue vista por Bloomberg. En público, el jefe máximo de Google ha demostrado ser optimista sobre las capacidades de su chatbot de búsqueda, aunque ha reconocido que todos los modelos tienen problemas para diferenciar lo real de lo imaginario, y ha enfatizado que la seguridad es una de las prioridades de la empresa.

Fuente: https://www.xataka.com/